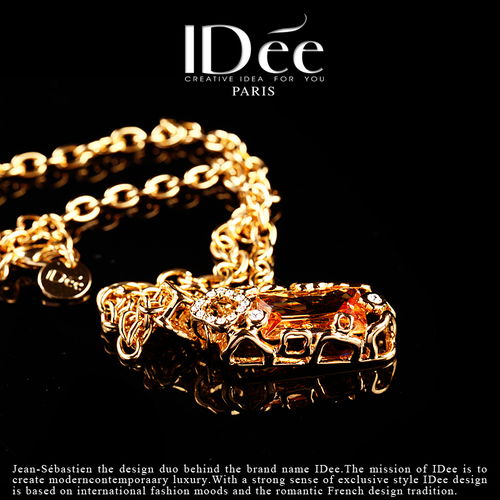

在追求個性與格調的時代,飾品早已超越了單純的裝飾功能,成為個人品味、藝術感知與生活態度的無聲宣言。法國idee時尚藝術飾品,正是這一理念的絕佳詮釋者。它將法式浪漫、先鋒藝術與精湛工藝融為一體,每一件作品,尤其是其華美奪目的寶石項鏈,都不再是簡單的配飾,而是可佩戴的微型藝術品,為珠寶首飾零售領域注入了一股清新而深邃的藝術氣息。

idee的品牌哲學根植于法國深厚的藝術沃土。它不盲目追隨瞬息萬變的潮流,而是致力于創造具有永恒美感和獨特敘事性的作品。設計師從現代藝術、建筑線條、自然形態乃至哲學思考中汲取靈感,將抽象的概念轉化為具象的、可觸摸的美麗。這使得每一件idee飾品都擁有獨特的靈魂與氣質,佩戴它,不僅是裝扮外表,更是在進行一場與藝術的親密對話。

其華美寶石項鏈系列,尤為引人入勝。品牌嚴選來自世界各地的優質寶石,無論是深邃如夜空的藍寶石、熾熱如火焰的紅寶石、清新如晨露的祖母綠,還是充滿現代感的珍稀半寶石,在idee的設計下都被賦予了新的生命。設計上絕非簡單的寶石堆砌,而是注重色彩的比例、形態的對比與空間的構建。寶石的切割與鑲嵌方式別具匠心,時而以流暢的金屬線條勾勒,時而以不對稱的布局打破常規,在璀璨光芒之中流露出高級的克制與理性的浪漫。一條idee寶石項鏈,往往能成為整體造型的焦點,瞬間提升氣場,彰顯佩戴者卓爾不群的審美力。

在珠寶首飾的零售體驗上,idee也與眾不同。它不僅僅是在銷售一件商品,更是在分享一種藝術化的生活方式。其零售空間通常設計得像小型藝廊,氛圍靜謐而富有格調,讓顧客能夠沉浸其中,細細品味每件作品背后的故事與匠心。專業的顧問不僅提供佩戴建議,更樂于交流設計理念,幫助顧客找到那件最能共鳴其內心世界的“藝術伴侶”。這種深度、個性化的服務,讓購買行為升華為一次愉悅的美學探索。

總而言之,法國idee時尚藝術飾品,特別是其華美寶石項鏈,代表了當下珠寶配飾領域的一種高階追求——它融合了藝術的創造性、珠寶的珍貴性與配飾的實用性。選擇idee,意味著拒絕平庸,選擇一種被藝術浸潤的日常生活,讓每一次頸項間的閃耀,都成為彰顯獨特品位與內在深度的自信表達。在紛繁的零售市場中,idee以其堅定不移的藝術品格,為懂得欣賞的都市精英提供了無可替代的個性之選。